Tandis que nous avions volontairement occulté son cas jusqu'à présent, voici venu l'heure de revenir sur la montée en puissance de NVIDIA, et sur les prémices de sa lutte avec celui qui allait devenir son principal adversaire pour la decennie à venir, ATI, futur AMD.

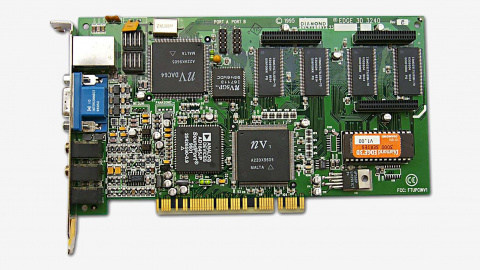

Revenons quelques années en arrière, vers la fin 95, période de lancement du STG2000 (NV1). Ce circuit donna naissance à des cartes particulièrement optimisées pour le jeu, comme la Diamond Edge 3D, puisqu’en plus de la 2D et de la 3D, elles pouvaient aussi gérer le son et une manette de jeu (en empruntant la connectique de la Sega Saturn). Plutôt performante, cette puce était par contre onéreuse. De plus, NVIDIA avait parié sur la mauvaise technologie, son architecture étant optimisée pour le rendu de surfaces quadratiques (des objets mathématiques à trois dimensions définis par une équation de la forme ax² + by² + cz² + 2fyz + 2gzx +2hxy + 2px +2qy + 2rz + d = 0), alors que ses principales concurrentes travaillaient sur des polygones. Une approche que Microsoft adopta d’ailleurs par la suite dans Direct 3D, et que NVIDIA ne parvint jamais à supporter correctement dans les drivers du NV1.

Entre les 1er échec (NV1) et le 1er succès (RIVA 128) de NVIDIA, il s'est écoulé 2 ans

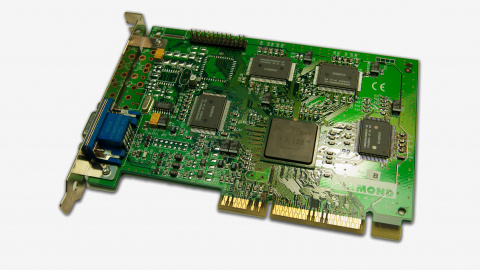

Plutôt que de persister dans cette voie, NVIDIA a largement revu sa copie en 1997 avec la Riva 128, une carte 3D travaillant sur des polygones et pleinement compatible avec Direct3D. Moins onéreuse qu’une Voodoo couplée à une carte graphique tout en offrant des performances et une qualité d’image relativement proches, la Riva 128 fut un beau succès commercial. Pour contrer la Voodoo 2, NVIDIA déclina ensuite cette architecture en produisant la Riva TNT (Twin Texel), une puce embarquant deux pixel pipelines et deux unités de texturing (alors que 3dfx n’avait doublé que le texturing, ce qui donnait moins de souplesse, le gain de performances ne survenant que dans les jeux utilisant du double texturing). Offrant une meilleure qualité d’image que la Voodoo2 grâce au rendu 32 bits, tout en ayant des performances relativement proches, la Riva TNT fut un nouveau succès commercial, même si elle ne dépassa pas les ventes de la Voodoo2, l’absence de support Glide étant encore un handicap à l’époque. L’architecture connut encore une dernière évolution, mineure (essentiellement une hausse de fréquence), l’année suivante, de quoi surpasser la Voodoo3, avant que NVIDIA ne porte le coup de grâce à 3dfx un peu plus tard…

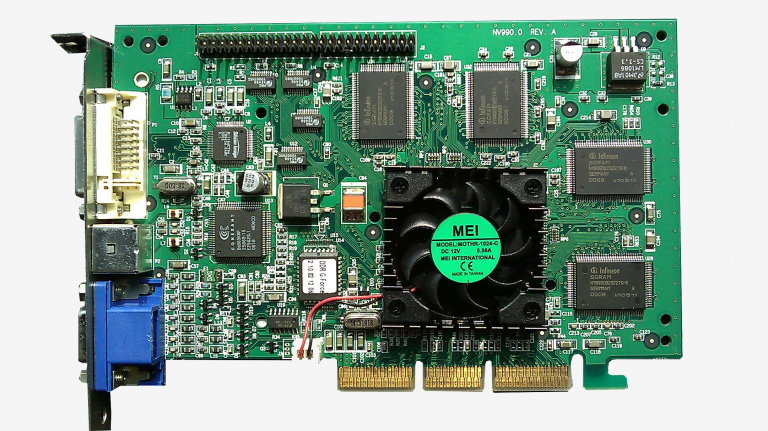

Ce coup de grâce, c’est le Transform & Lightning matériel, c’est-à-dire la prise en charge par le GPU des calculs géométriques qui étaient jusque-là effectués par le CPU : mise à plat d’une scène 3D dans une image 2D (transform) et correction des couleurs des éléments en fonction de l’éclairage (lightning). La gamme GeForce était née.

GeForce 256, la première d’une longue série (et également l’une des premières carte à sortie DVI

Contrairement à l’ajout d’unités de calcul ou à la hausse de fréquence, le T&L matériel ne bénéficiait qu’aux jeux conçus pour en tirer parti, jeux qui étaient rares dans les premiers mois suivant le lancement de la GeForce 256. Cependant, comme NVIDIA avait aussi doublé le nombre d’unités de calcul par rapport à la TNT2, la GeForce était tout de même largement plus performante dans les jeux existants.

Bien avant les premières Radeon X2, ATI avait déjà mis deux GPU sur la Rage Fury Maxx. La réponse des concurrents fut donc dans un premier temps de doubler eux aussi le nombre d’unités de calcul, avec des cartes embarquant deux puces, les Voodoo5 à deux VSA-100 chez 3dfx et les Rage Fury MAXXX à deux Rage 128 chez ATI (première carte graphique grand public à embarquer deux GPU). Comme nous l’avons vu plus haut, 3dfx n’a pas survécu à cette révolution, contrairement à son concurrent canadien qui n’a pas trop tardé à proposer une vraie réponse, avec là encore un nom que tout le monde connait aujourd’hui : Radeon. Sorties seulement six mois après les premières GeForce, les premières Radeon ont largement remis ATI dans la course, puisqu’elles approchaient les performances des GeForce 2 GTS qui avaient très rapidement remplacé la première génération de GeForce.

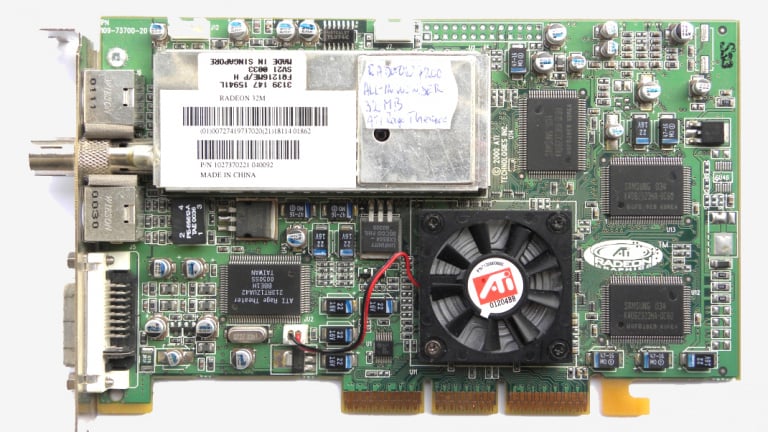

La première Radeon (7200), ici en version All-In-Wonder, avec tuner TV

16 ans plus tard, ce sont toujours les Radeon (désormais sous la marque AMD) et les GeForce qui s’affrontent et s’échangent régulièrement le titre de carte 3D la plus rapide, alors que tous les autres concurrents ont quasiment disparu. Bien entendu, même si les noms sont restés, les architectures actuelles ne sont pas de simples évolutions de celles de l’époque, les GPU étant incontestablement les puces ayant le plus fortement évolué sur les dernières années du côté des PC grand public. Même s’il n’y a plus que deux concurrents, de nombreuses innovations ont eu lieu, tant sur le plan de l’architecture (apparition des vertex shaders, puis des shaders unifiés, nouvelles possibilités offertes par le PCI-Express, très forte augmentation du nombre d’unités de calcul, retour des solutions à 2 cartes ou plus, rendu interne sur plus de 32 bits, mémoire HBM, etc…) que des fonctionnalités (nouveaux types d’antialiasing et de filtrage des textures, développement des fonctionnalités d’encodage/décodage vidéo, GPGPU…).

Le ray-tracing permet des rendus extrêmement précis, mais exige beaucoup de puissance

Désormais bien installés, les deux géants de la 3D ont aujourd'hui peu de chances d’être bousculés par un nouvel entrant, à moins d’une nouvelle révolution dans la 3D, comme pourrait l’être par exemple l’adoption du ray-tracing, qui consiste à effectuer le rendu en simulant le trajet des rayons lumineux. Mais même si elle permet des rendus d’une qualité exceptionnelle, cette approche reste complexe à maitriser et nécessite des calculs bien plus lourds, donc à peu de chances de devenir la norme à court terme. En attendant, c’est surtout Intel qui peut venir jouer les troubles fêtes, en coupant les revenus d’AMD et NVIDIA sur l’entrée de gamme, très lucrative, avec ses circuits graphiques intégrés qui n’ont plus à rougir face aux « petites » GeForce et Radeon.