L’intelligence artificielle ChatGPT semble avoir trouvé un adversaire de taille : un étudiant est parvenu à créer l’ébauche d’un programme pouvant détecter si l’IA en question a été utilisée pour produire du contenu texte.

ChatGPT, une IA qui peut créer du texte et passer pour un humain

L’actualité de plus en plus palpitante du monde de l’intelligence artificielle est dominée par ChatGPT, la nouvelle venue qui ne semble avoir que peu de limite quant à imiter la créativité humaine. Elle est à la fois très performante, utile mais aussi un peu flippante, tant les résultats obtenus sont pertinents.

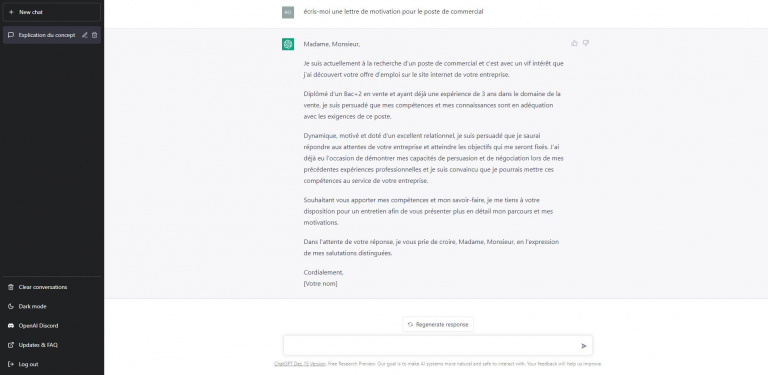

Concrètement, il suffit de se rendre sur l’outil de ChatGPT, puis de rentrer une demande, quelle qu’elle soit. Cela peut être une question, ou bien une requête sur l’écriture d’un texte avec un thème précis. Par exemple, voici ce que Chat GPT répond lorsque je lui demande de me faire une lettre de motivation pour le poste de commercial.

Ne souhaitant pas perdre de temps avec la forme et les mots à utiliser, je peux me servir de ce que l'IA vient de me donner et de l’adapter à ma situation. En fonction de ce que vous souhaitez faire, il est possible que de légères modifications doivent être effectuées pour obtenir quelque chose de pertinent pour vous.

Bref, c’est un algorithme très sophistiqué, mais ce qui est encore plus perturbant, c’est l’accès totalement public de ce genre d’outil. N’importe qui peut l’utiliser, et quand n’importe qui peut l’utiliser, cela crée forcément des problèmes. Comment un professeur fait pour savoir si les devoirs rendus par ses élèves n’ont pas été rédigés par une IA ? Comment un employeur peut s’assurer qu’une lettre de motivation a bien été pensée par son auteur présumé ?

Un jeune étudiant créer un programme pour détecter ChatGPT

On ne va pas se mentir, ChatGPT a beau être rempli de potentiel, il comporte des désavantages, particulièrement quand on attend de quelqu’un qu’il délivre un texte ou une réponse unique et personnelle, mais qu’une IA est utilisée à la place. C’est pour empêcher cela que Edward Tian, un étudiant codeur, a décidé de passer son nouvel an à développer un algorithme (oui, encore un autre) permettant de contrer ChatGPT, appelé GPTZero.

I spent New Years building GPTZero — an app that can quickly and efficiently detect whether an essay is ChatGPT or human written

— Edward Tian (@edward_the6) January 3, 2023

Pour l’instant, il ne s’agit que d’une ébauche, mais une version de démonstration est déjà disponible pour le commun des mortels. En créant un compte, on peut rapidement tester l’outil soi-même.

Le test de GPTZero

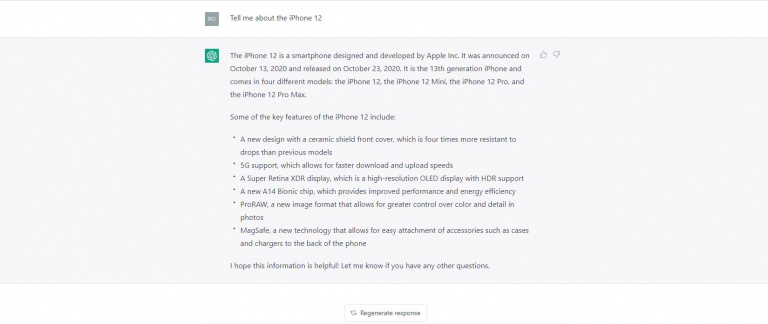

En se rendant sur ce lien, on se retrouve sur une page toute simple où l’on est invité à entrer du texte afin qu’il soit analysé. Pour notre test, j’ai rentré deux textes différents : le premier est un extrait d’un des derniers articles que j’ai écris moi-même, le deuxième est la réponse d’une requête que j’ai faite à ChatGPT, avec pour demande : parle-moi de l’iPhone 12 (en anglais pour plus de précision).

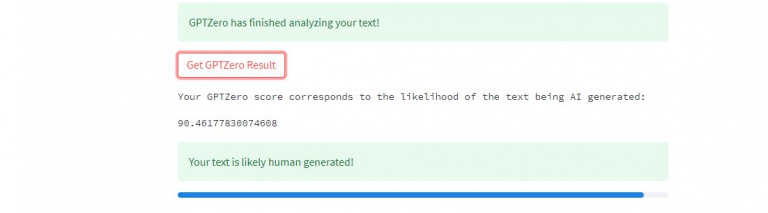

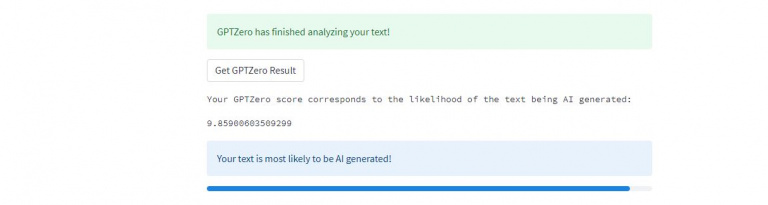

GPTZero analyse le texte et donne un “indice de perplexité”, qui définit l’aspect plus ou moins aléatoire du contenu. Plus le score est bas, plus il y a de chances qu’il s’agit d’un texte généré par une IA. Les scores sont les suivants :

- Texte humain : 90,46 (indice de perplexité)

- Texte généré par ChatGPT : 9,85 (indice de perplexité)

L’analyse de GPTZero est donc correcte, elle indique bien que le premier texte est “sûrement écrit par un humain” et le deuxième est “sûrement généré par une IA”. Maintenant, il reste à prouver que GPTZero peut différencier de manière fiable les textes d’humains et d’IA sur le long terme.