Avant de nous attaquer à toutes les problématiques qui entourent les nouvelles technologies d’affichages TV, offrons-nous une petite mise au point sur ce qui se cache derrière l'acronyme 4K. L’occasion de préciser que l’on s’attachera dans ce dossier à parler d’Ultra HD, plutôt que de 4K.

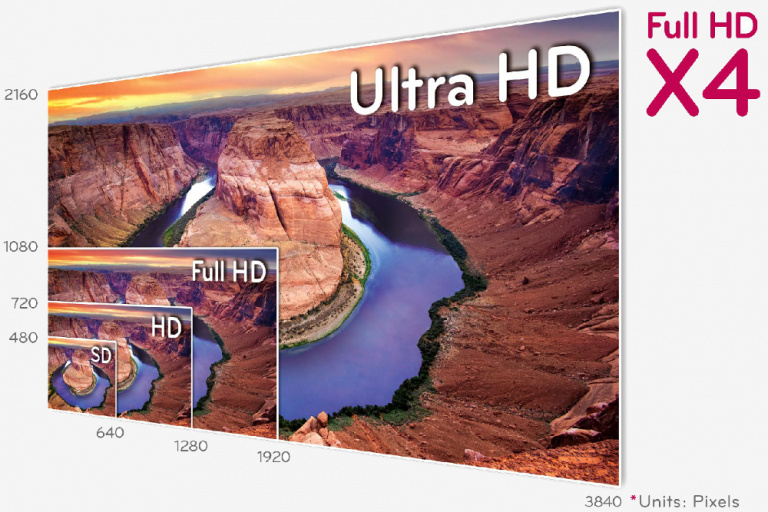

Très basiquement, le terme 4K représente une résolution d’affichage, au même titre que le terme Full HD. Cette dernière est exprimée en pixel, et elle définit le nombre de points de couleurs qu’un écran peut utiliser pour former une image. La définition 4K permettra ainsi d’afficher une image contenant 8 847 360 pixels, soit 4096 pixels en largeur, et 2160 pixels en hauteur. Là-dessus, vous allez nous dire : certes, mais pourquoi cette résolution est-elle différente de celle spécifiée sur la plupart des TV ou moniteur dits « 4K » vendus dans le commerce ?

En réalité, la résolution 4K telle que nous venons de la définir reste aujourd’hui spécifique à l’industrie du cinéma et c’est dans cette résolution que sont par exemple projetés les films en salles. Les systèmes d’affichage grand public, eux, utilisent une définition dérivée de la 4K, qui respecte le format 16/9ème, et qui propose donc un rendu sur 3840 par 2160 pixels. D’un point de vue technique, on ne parle alors plus de 4K, mais d’Ultra HD. Un terme qui lui-même, recouvre en vérité non pas une, mais deux résolutions : l’Ultra HD 4K en 3840 × 2160, et l’Ultra HD 8K en 7680 × 4320… Finalement, tout cela paraissait sans doute un peu complexe à retranscrire sur un plan marketing, si bien que beaucoup de marques ont décidé de rattacher leurs produits à une simple appellation « 4K », même si elle n’est techniquement pas exacte.

Autre élément important : lorsque l’on parle de 4K, ou d’Ultra HD, on parle principalement de nouvelles définitions d’affichage, et quoi de plus normal : ces deux dernières années, de nombreux écrans et TV ont été commercialisés sur la seule base de cet avantage. Pour autant, le déploiement de ces définitions dans l’espace télévisuel va beaucoup plus loin, et s’accompagne d’autres avancées technologiques, que l’on ne voit malheureusement apparaitre que maintenant pour certaines (l’HDR, par exemple), mais qui sont des conséquences directes des spécifications techniques qui régissent l’Ultra HD. Ainsi, outre une résolution améliorée, le standard Ultra HD tel qu’il a été défini par l’UIT (l’Union Internationale des Télécommunications) pour les écrans TV intègre aussi des spécifications sur les fréquences d’affichage, la profondeur des couleurs, et l’espace colorimétrique à supporter.

Si l’on prend le cas de la fréquence d’affichage, la norme Rec.2020 rédigée par l’UIT indique qu’elle doit pouvoir monter à 120 Hz en Ultra HD, ce qui implique plus de données à transférer de la source vers l’afficheur, et qui se traduit par un besoin en bande passante plus important. En parallèle, l’arrivée d’un nouveau format comme l’Ultra HD est souvent pour les éditeurs de contenus l’occasion de revoir leurs systèmes de protection (ou DRM). Deux éléments qu’il a donc fallu intégrer au travers d’évolutions dans les normes de connectique. Les TV Ultra HD se sont donc peu à peu dotées de ports HDMI qui sont passés en version 2.0, afin de permettre un affichage en 3840x2160 à 60 Hz (contre 30 Hz pour l’HDMI 1.4). Au-delà de ça, cette bascule était aussi nécessaire afin d’assurer le support du système de protection de contenu HDCP, indispensable pour visionner des contenus 4K sous Netflix, par exemple.

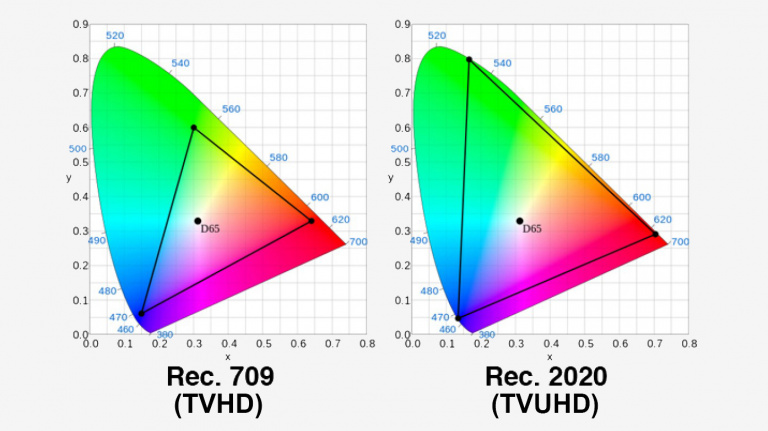

Parallèlement, cette même norme Rec.2020 propose un certain nombre de modifications au niveau de l’espace colorimétrique, ou gamut, qui définit l’ensemble des couleurs qu’un écran peut gérer. Exprimé ainsi, cela n’a l’air de rien, mais ce nouveau standard va permettre de pousser certaines évolutions techniques importantes. Par exemple, l’encodage des couleurs sur les écrans se faisait jusqu’à présent sur 8 bits, ce qui permettait de profiter de 256 niveaux de nuances par couleur, soit 16,8 millions de teintes affichables par pixel en système RGB. Afin de se rapprocher des objectifs définis par le standard Ultra HD, les dalles des écrans vont maintenant devoir gérer l’encodage des couleurs sur 10 bits (et plus tard sans doute, sur 12 bits), avec à la clé, la possibilité de proposer 1024 niveaux de gradation par couleur, soit une nouvelle palette de 1,07 milliard de couleurs pour chaque pixel. De quoi commencer à se rapprocher de ce que l’œil humain est capable de distinguer en termes de nuances (jusqu’à présent, on en était assez loin).

Évidemment, le fait de pouvoir encoder un signal vidéo comprenant plus de richesse dans les couleurs est une avancée, mais encore faut-il que les technologies d’affichage puissent les retranscrire en conservant cette même précision. De fait, le support de l’Ultra HD implique également l’utilisation de dalles proposant des taux de contrastes plus importants, et des systèmes de rétroéclairage plus homogènes. Et c’est ainsi que ces derniers mois, de nouveaux termes ont fait leur apparition dans les fiches techniques des fabricants : des termes comme OLED, Full LED, Local Dimming, ou Quantum Dot…

Ainsi, pour nos télévisions, l’application de la définition Ultra HD ne se limite pas à afficher plus de pixels. Pour autant, on peut se demander pourquoi l’ensemble de ses améliorations annexes ne sont pas intervenues dès l’arrivée des premiers écrans Ultra HD ? Tout simplement parce que l’établissement de normes pour l’industrie et le développement des technologies qu’elles régissent n’évoluent pas toujours sur les mêmes timings. Quant à savoir pourquoi toutes ces nouvelles spécifications semblent importantes maintenant alors qu’elles paraissaient très dispensables l’année dernière ? La réponse à ces questions tient en un mot : HDR, ou High-Dynamic Range, qui sera l’objet du chapitre suivant.