NVIDIA a dévoilé lors de la GTC 2022 sa nouvelle puce serveur Grace. Celle-ci permet de retrouver 144 cœurs Arm v9 et une bande passante mémoire de 1 To/s !

Le constructeur américain nous a habitués à son petit rythme. En début d’année, nous retrouvons toujours la GTC quelques jours avant la GDC, où le grand patron de NVIDIA Jensen Huang dévoile les plus grandes avancées technologiques de sa firme. Et cette année, le monsieur n’a toujours pas déçu. Le constructeur y a dévoilé ses ambitions côté serveur, en mettant en avant une nouvelle architecture ARM qui n’est pas sans rappeler les efforts faits par Apple sur le M1 Ultra récemment.

Grace, la super-puce 144 cœurs de NVIDIA

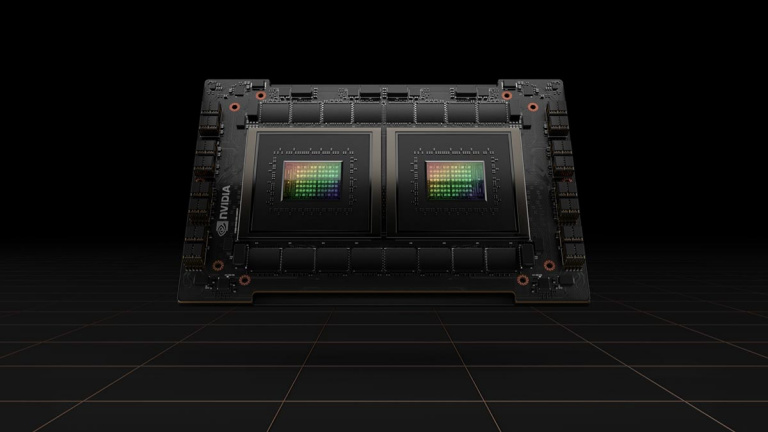

Si le rachat d’ARM a échoué, NVIDIA n’a pas pour autant abandonné l’idée d’utiliser sa plateforme. Nous découvrons aujourd’hui sa “super-puce” baptisée Grace, qui est un CPU à destination des serveurs. Grâce à la nouvelle technologie NVLink-C2C, le constructeur est désormais capable de combiner son CPU avec un second CPU (comme le fait le M1 Ultra) pour former cette super-puce à 144 cœurs Arm v9.

Cette nouvelle plateforme est la première compatible avec la mémoire LPDDR5x et promet une bande passante totale de 1 To/s. Bien évidemment, le focus de NVIDIA pour celle-ci est à voir du côté des travaux de recherche où Grace pourra offrir des performances largement supérieures pour une consommation amoindrie. La totalité de la plateforme consomme en effet 500W.

Grace Hopper, la super-puce CPU+GPU

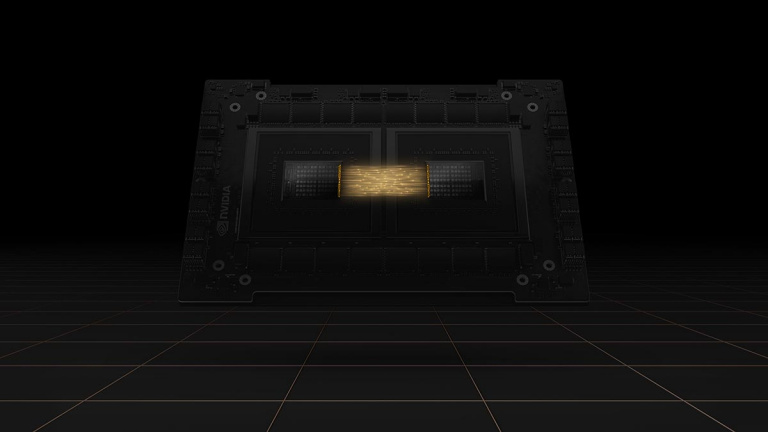

Ce n’est pas la seule chose possible grâce à cette nouvelle plateforme tournant autour du connecteur NVLink-C2C, puisqu’elle est intrinsèquement modulaire. Plutôt que de coupler deux CPU comme l’exemple précédent, vous pouvez aussi y rattacher le nouveau GPU de la génération Hopper.

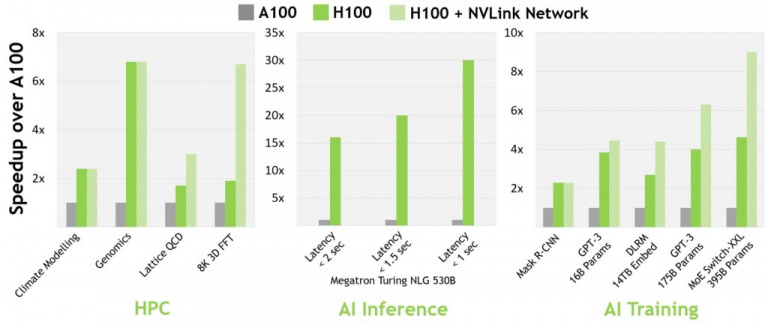

NVIDIA a présenté la H100, qui profite de Tensor Cores de 4e génération offrant des performances jusqu’à 6 fois plus importantes que la génération précédente. Entre autres améliorations sur les calculs d’instruction DPX (jusqu’à 7 fois plus importants) ou encore d’IEEE FP64 et F32 trois plus rapides.

Dans l’absolu, grâce au NVLink-C2C, il est possible d’interconnecter à sa guise un CPU et/ou un GPU pour optimiser son workflow selon les analyses voulues. Ces puces sont avant tout dédiées à la recherche, à l’IA ou encore au travail dans le cloud computing. NVIDIA n’est pas peu fier de la puissance qu’il a développée, et déclare que 20 GPU H100 pourraient encaisser à eux-seuls le trafic internet du monde entier. Au vu de sa plateforme, on serait enclin à y croire.