Si la plupart des gens se contente des performances livrées clé-en-main par NVIDIA, d’autres utilisateurs plus avertis entendent tirer le maximum de leurs chers composants, en les poussant au-delà de leurs spécifications de fonctionnement. Pour eux (et pour les partenaires du fabricants aussi sans doute), les GeForce RTX disposent d’une marge de manœuvre à ce niveau. De combien ? C’est ce dont nous allons discuter dans cette page.

D’un point de vue overclocking, les GeForce RTX se positionne dans la droite ligne des modèles GTX qui les ont précédés ces dernières années. Le système GPU Boost, ici en version 4.0, permet d’appliquer une fréquence optimale pour la puce graphique en fonction de différents critères de fonctionnement (Charge de calcul, température, limite de consommation, tensions appliquées). Et si au quotidien, tout cela est géré par un algorithme, l’utilisateur dispose d’une certaine latitude, afin de relever les limites de ces critères, et d’en extraire quelques FPS supplémentaires en jeu. Concrètement, ce contrôle manuel passe par une API, que l’on retrouve intégrée dans la plupart des logiciels d’overclocking : Afterburner chez MSI, Firestorm chez Zotac, ou Precision X1 chez EVGA.

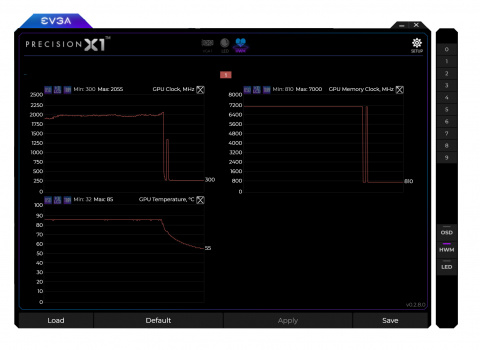

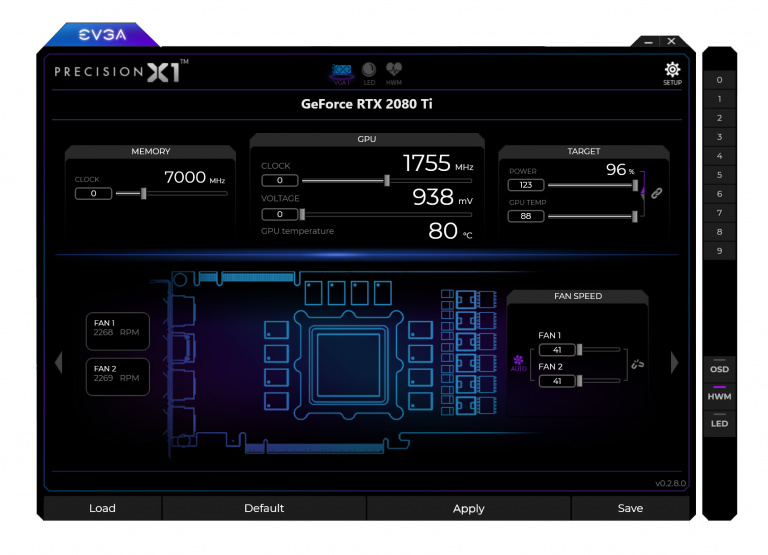

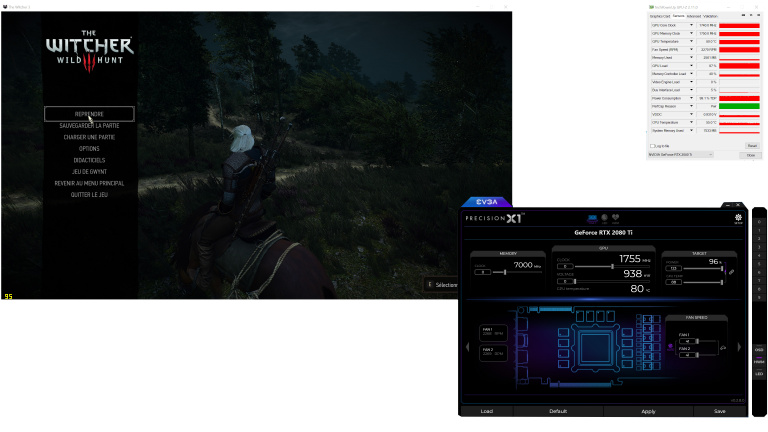

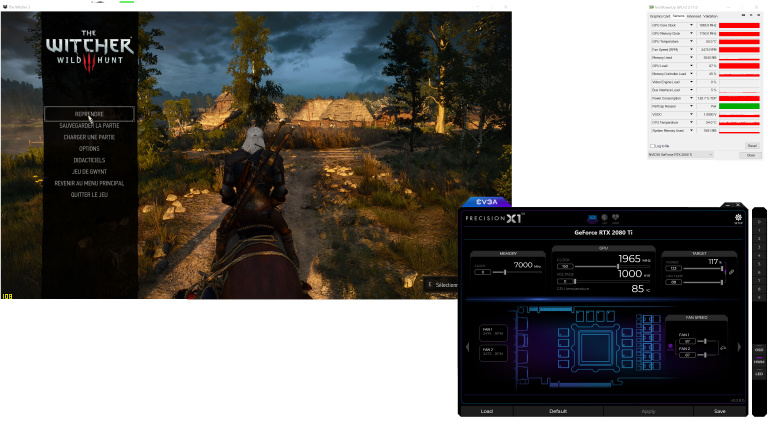

Nous avons pour notre part utilisé le logiciel Precision X1 pour nos essais, logiciel qui a profité de l’arrivée de cette nouvelle génération de carte graphique pour faire peau neuve. Sur le fond, on conservera la même palette de contrôles à actionner, comme le montre les captures d’écrans rassemblées sur cette page. Chaque paramétrage peut être sauvegardé sous forme de profil, que l’on peut appeler à la volée. Precision X1 donne également la main sur les courbes de ventilation, en proposant une gestion séparée de chaque turbine. Il offre aussi la possibilité de monitorer l’ensemble des constantes du PC, soit sous forme de courbes, soit en affichage OSD. Et l’option Scanner est bien entendu présente, comme nous le soulignions quelques pages auparavant. Finalement, c’est surtout sur la forme que Precision X1 marque sa différence : la nouvelle interface est moderne, claire, très visuelle, et pour finir, très agréable à manipuler. Quant à savoir si elle « fait le job », comme on dit, voyons cela…

Comme d’habitude, nous utilisons plusieurs leviers successifs afin de relever le niveau de performances de nos cartes : d’abord, nous poussons simplement les limites de consommation et de température au maximum, ce qui permet de libérer GPU Boost d’éventuelles restrictions liées à une enveloppe thermique trop juste. Puis nous augmentons la fréquence GPU, jusqu’à parvenir en limite de stabilité. Après quoi nous faisons la même chose sur la fréquence mémoire. Par manque de temps, nous ne poussons pas l’exercice jusqu’à modifier les tensions, ou les courbes de ventilations.

Concrètement, notre exemplaire de RTX 2080 Ti Founders Edition tourne à 1745 Mhz en moyenne (entre 1665 et 1822 MHz selon les jeux). Sur The Witcher 3, notre référence pour ce qui est des tests d’overclocking, la fréquence stabilisée est de 1750 MHz. Le simple fait de débrider les limites de consommation offre déjà un gain de 80 MHz, qui se traduit par un peu plus de bruit (on prend 200 RPM sur chacun des ventilateurs) et 5°C sur le GPU. Derrière, on commence à travailler sur la fréquence, d’abord à +50 MHz, puis +100, puis +150. Sur cette dernière valeur, la fréquence oscillait entre 1955 et 1965 MHz. Toutefois, dans ce cas de figure, on retouche du doigt les limites de consommation et de températures de la carte. D’autre part, nos tentatives de pousser au-delà nous ont systématiquement conduit au crash, dès que la fréquence tentait de passer la barre des 2 GHz. Entre ce gain de 12% sur la fréquence GPU, et celui de 7% sur la mémoire, on obtient un bonus de 5 à 7% en performances. C’est toujours bon à prendre.

En ce qui concerne la RTX 2080, on part cette fois d’une fréquence moyenne de 1888 MHz, et d’une fréquence effective sur The Witcher 3 de 1870 MHz. En repoussant les limites de consommation et de température, on retrouve un premier gain léger : 1905 MHz sur le GPU, pour une montée des constantes environnementales toute aussi légère. En l'augmentant l'offset de la fréquence, nous ne sommes pas parvenus à monter au-dessus de 130 MHz, ce qui correspondra à une fréquence effective de 2010 MHz. Et côté mémoire, nous sommes toujours sur une valeur maximale de 7500 Mhz. La marge d'overclocking semble un peu plus restreinte, mais dans la mesure où les limites de consommation n’étaient pas atteintes, il était sans doute possible de gratter un peu plus en jouant sur les tensions appliquées au GPU.

Et la 2070 de Gigabyte ? Sans aucune discussion, c'est celle qui nous a donné les meilleurs résultats de montée en fréquence, avec un très joli offset d’overclocking de 250 MHz, pour une valeur finale qui oscillait entre 1950 et 2 GHz.

Pour conclure sur ce chapitre overclocking, notez deux remarques importantes : la première, c’est que nous avons également testé la fonction Scanner cher à NVIDIA qui rappelons-le, est une sorte d’overclocking entièrement automatisé : c’est alors un algorithme qui va aller tester les limites de chaque point de la courbe de fréquence, afin de l’ajuster au mieux des possibilités pratiques du GPU. Derrière, un clic suffit pour appliquer la nouvelle courbe de référence optimisée. Dans les faits, cela fonctionne plutôt bien, puisque sur le fonctionnement en charge, le scanner nous a donné des fréquences équivalentes à ce que nous avions défini manuellement à 5MHz prêt. Ensuite, il sera intéressant de reprendre ces essais lorsque les fonctionnalités liées au ray tracing et au calcul d’IA seront exploitables, afin de voir de quelle manière l’overclocking joue sur ces aspects particuliers du GPU. Espérons que nous aurons rapidement l’opportunité de répondre à cette question.