Depuis son premier déploiement en mai 2016, l’architecture Pascal a livré tous ces secrets. Nous allons cependant nous permettre une petite piqure de rappel sur ce qu’elle a apporté sur un plan technologique, avant de nous pencher plus précisément sur les spécifications techniques de sa nouvelle déclinaison, la GTX 1070 Ti.

Souvenez-vous, nous étions au milieu de l’année 2016, et les premières cartes sous architecture Pascal s’apprêtaient à faire leur entrée sur le marché grand public, avec devant elles plusieurs défis de taille : ainsi, les nouveaux GPU (ou en tout cas, les plus véloces d’entre eux) se devaient pour commencer d’offrir une puissance de calcul compatible avec les exigences de la résolution montante à l’époque : l’Ultra HD. Dans le même ordre d’idée, la VR, dont on ne savait encore à l’époque quel impact elle allait avoir sur l’univers du jeu, imprimait de nouvelles contraintes technologiques pour les GPU modernes, en matière d’affichage ou de latence. Enfin, mai 2016 sonnait également l’arrivée de l’API DX12 de Microsoft, qui elle aussi, imposait son lot de nouvelles spécifications à intégrer.

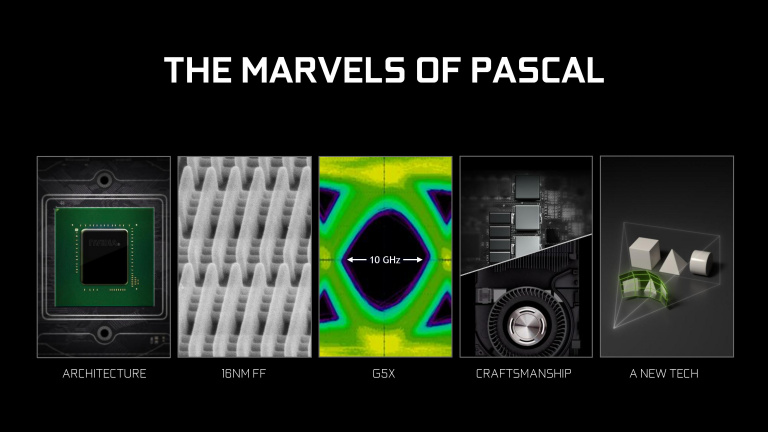

Pour faire face à tout cela, NVIDIA a bien entendu usé de nombreux leviers techniques, mais l’un des plus importants aura sans doute été le passage à une finesse de gravure de 16 nm FinFET, passage qui s’est accompagné d’un gros travail sur le design de la puce, afin de permettre une forte montée en fréquence des GPU. Résultat des courses : les GTX 1060, 1070 ou 1080 étaient pour la plupart capables d’atteindre les 2 GHz, générant mécaniquement des hausses de performances sensibles par rapport à la génération Maxwell précédente. Autre levier, celui de la mémoire embarquée : outre le passage à la GDDR5X sur les modèles les plus haut de gamme (dont la GTX 1070 Ti), les ingénieurs NVIDIA ont largement travaillé leur moteur de compression, afin d’obtenir une amélioration considérable de la bande passante globale disponible.

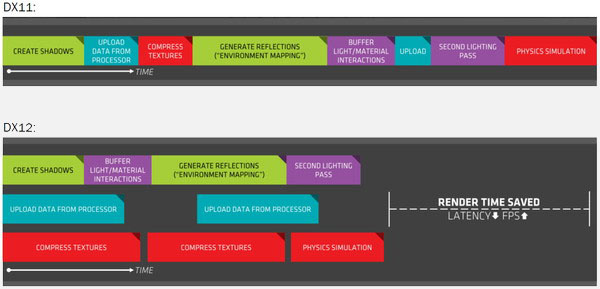

En parallèle, d’autres technologies ont été développées afin de répondre aux besoins spécifiques que nous évoquions plus haut : sur le front de DirectX 12, par exemple, NVIDIA a fait évoluer son moteur de commande, afin qu’il puisse gérer de manière plus fine l’attribution des ressources GPU et les files de commandes transmises au GPU. Ainsi, alors que le GPU devait auparavant (sous DX11) effectuer les commandes qui lui étaient envoyées de manière séquentielle, il peut désormais (dans le cadre d’un jeu DX12) et le cas échéant en traiter certaines en parallèle, lorsqu’elles feront appel à des ressources GPU différentes (Texturing, unité de calcul, interface mémoire…). NVIDIA a également travaillé sur la priorisation des commandes, utile pour l’exécution d’une tâche qui bloque un process de calcul en cours : les GPU Pascal ont ainsi plus de facilité à stopper un travail en cours pour en prioriser un autre (un mécanisme que NVIDIA appelle la préemption).

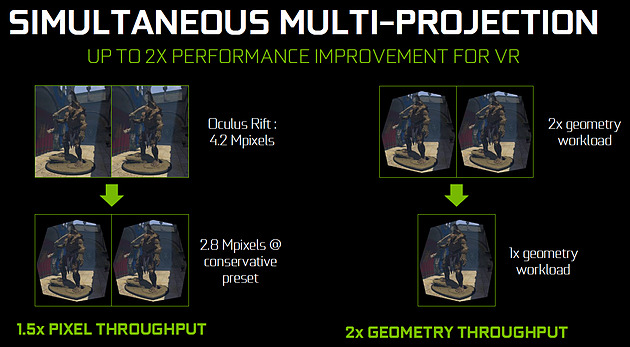

Quant à la question de la VR, là encore, les améliorations dans ce sens ont été nombreuses, mais la plus emblématique restera l’intégration du nouveau moteur de calcul baptisé SMP. Très schématiquement, les unités qui le composent s’attacheront à améliorer le rendu d’une image 3D, que ce soit en termes de qualité ou de vitesse de traitement, lorsqu’elle est projetée sur un système d’affichage multiple (typiquement, un casque VR avec deux écrans). Dans le cadre d’un affichage de ce type, le GPU se contentait auparavant de traiter les deux écrans comme un seul, l’image calculée étant alors la résultante de la somme des résolutions des 2 écrans. Problème : comme le montrent les schémas ci-dessous, cette forme de projection est valable lorsque les écrans sont positionnés sur le même plan.

C’est là qu’intervient le moteur SMP : il va autoriser le rendu d’une scène 3D sur plusieurs points de vue, de manière à obtenir plusieurs projections de la scène, chacune d’elle correspondant précisément à chacun des écrans qui vont composer le système d’affichage. Il en résultera une image plus juste d’un point de vue géométrique. Mieux encore : le traitement de ces projections multiples aurait auparavant entrainé de très lourdes pertes de performances, dans la mesure où chaque portion de l’image globale aurait dû traverser tout le pipeline avant que le GPU ne puisse s’attaquer à la portion suivante, multipliant la durée totale de rendu de l’image. Grâce au moteur SMP de Pascal, le traitement de ces projections sera assuré sur une seule passe, jusqu’à 16 projections.

| GTX 1070 Ti | GTX 1080 | GTX 980 Ti | GTX 1070 | |

|---|---|---|---|---|

| GPU | GP104 (Pascal) | GP104 (Pascal) | GM200 (Maxwell) | GP104 (Pascal) |

| Unités de calcul | 2432 | 2560 | 2816 | 1920 |

| Unités de texturing | 152 | 160 | 176 | 120 |

| ROPs | 64 | 64 | 96 | 64 |

| Fréquence GPU de base | 1607 | 1607 | 1000 | 1506 |

| Fréquence GPU "Boost" | 1683 | 1733 | 1075 | 1683 |

| Type et quantité de mémoire | 8 Go GDDR5X | 8 Go GDDR5X | 6 Go GDDR5 | 8 Go GDDR5 |

| Bus mémoire | 256 bits | 256 bits | 384 bits | 256 bits |

| TDP | 180W | 180W | 250W | 150W |

Derrière ces orientations technologiques, les spécifications de la GTX 1070 Ti seront dans la lignée de celles qui caractérisaient les cartes GTX 1070 et 1080, et quoi de plus logique, puisque toutes reposent au final sur le même GPU, un GP104. La nouvelle référence profitera ainsi de 2432 Cœurs CUDA activés, de 152 Unités de texturing, et de 64 ROPs, pour une fréquence GPU globale qui sera de 1607 MHz de base, et 1683 MHz en mode boost. Sur la base de ces chiffres, on comprend que l’on reste bien plus proche des spécifications de la GTX 1080 que de celles de la GTX 1070.

Quant à la carte elle-même, elle ne surprendra personne et s’appuiera sur le design éprouvé des précédents produits Founders Edition : un code couleur naviguant entre le noir et le gris métal, un rétroéclairage du logo sur la tranche et un système de refroidissement basé sur un ventilateur radial qui va venir expulser l’air vers l’arrière, à travers un large radiateur, lui-même en contact avec le GPU et les puces mémoires. Sur le bracket arrière, on trouve 5 sorties : trois DisplayPort (1.2, 1.3/1.4 Ready), une Dual-Link DVI, et une HDMI (2.0b, avec support HDCP 2.2). L’alimentation externe passera par un simple connecteur PCIE 8 broches, tandis que l’étage d’alimentation sera composé de 5+1 phases (5 pour le GPU, 1 pour la mémoire).

Tout cela pour quelles performances pratiques ? C’est ce que nous allons vous dévoiler, non sans avoir fait un petit point sur notre protocole de test auparavant.